Wissensbasierte KI-Systeme (RAG) verändern die Art, wie Unternehmen Wissen nutzen. Doch wenn der ROI ausbleibt oder das KI-Projekt zu scheitern droht, liegt das selten am Basismodell. Es liegt an unsichtbaren Fehlerquellen in der RAG-Architektur.

RAG-Systeme (Retrieval-Augmented Generation) verhalten sich grundlegend anders als jede Software, die Sie bisher in Ihrem Unternehmen implementiert haben: Sie sind nicht-deterministisch. Während klassischer Code bei identischem Input immer das identische Ergebnis liefert, agieren Large Language Models (LLMs) probabilistisch. Für Sie als Entscheider bedeutet das: Sie benötigen neue, systematische Messmethoden, um die Performance Ihrer generativen KI aktiv zu steuern.

Die aktuelle Digitalisierungsumfrage der IHK Südthüringen bestätigt: 83 % der regionalen Unternehmen sehen in KI bereits einen entscheidenden Hebel für ihre Produktivität. Der kritische Erfolgsfaktor liegt nun darin, dieses enorme Potenzial durch professionelle Validierung in messbare und prozesssichere Markterfolge zu übersetzen.

Der strategische Pain Point bei RAG Systemqualität liegt dabei nicht in der Technologie selbst, sondern in der Messbarkeit des Business-Impacts. Eine signifikante Effizienzsteigerung in Unternehmen durch KI lässt sich nur dann nachhaltig realisieren, wenn der Übergang vom Pilotprojekt zum produktiven Betrieb prozesssicher validiert wird. Ohne ein dediziertes Framework für AI-Evaluations riskieren Sie „Silent Failures“ – schleichende Qualitätsverluste in der RAG-Pipeline oder veränderte Modell-Antworten, die erst auffallen, wenn das Nutzervertrauen bereits erodiert ist oder die operativen Kosten unkontrolliert skalieren.

Echte Wertschöpfung entsteht erst dann, wenn technologische Exzellenz und strategische Governance ineinandergreifen. Bei SMADEV verstehen wir Qualitätssicherung (AI-Evals) daher nicht als reaktive Fehlerkorrektur, sondern als proaktives Steuerungsinstrument. Wir laden Sie ein, die Komplexität Ihrer KI-Infrastruktur nicht als Black-Box, sondern als optimierbare Wertschöpfungskette zu begreifen. Nur wer die Validierungskette vom „Research to Revenue“ beherrscht, transformiert technisches Potenzial in messbare Marktführerschaft.

Key-Takeaway:

„Nachhaltige Effizienzsteigerung erfordert dynamische AI-Evaluations. So machen Sie die Verlässlichkeit und Kapitalallokation Ihrer Systeme jederzeit steuerbar.“

Jetzt Whitepaper herunterladen

Wie systematische AI-Evaluations

die Qualität Ihres RAG Systems überwachen.

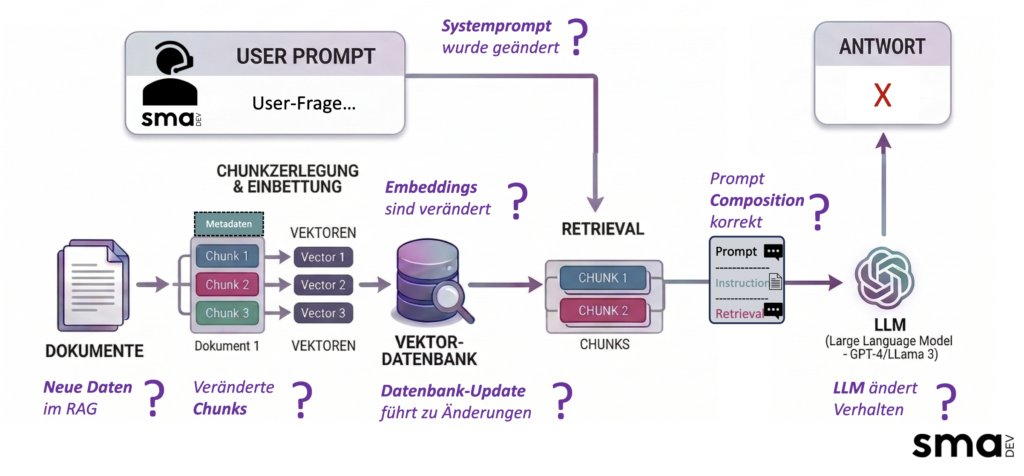

Stellen Sie sich die Datenverarbeitung in einem RAG-System wie eine hochmoderne, automatisierte Fertigungsstraße vor. In einer traditionellen Software-Pipeline sind die Rohstoffe (Daten) und die Maschinen (Code) exakt spezifiziert. Das Ergebnis ist absolut vorhersagbar.

Bei einem KI-gestützten System hingegen verändern sich sowohl die Rohstoffe als auch die Logik der Verarbeitung im laufenden Betrieb. Wenn Sie beispielsweise neue Dokumente in Ihre Vektordatenbank (Definition hier im Glossar) einspeisen, ändert sich die mathematische Struktur des gesamten Suchraums. Das System bleibt hochgradig effizient, aber die Nuancen der Antworten verschieben sich. Traditionelle Richtig/Falsch-Abfragen greifen hier zu kurz. Sie sehen das fertige Produkt, aber nicht die minimale Abweichung in der Legierung.

Das obenstehende Prozessbild verdeutlicht die Architektur einer modernen Wissensabfrage und zeigt präzise, wo die Hebel für eine erfolgreiche Qualitätssicherung liegen. Jede Station in diesem Prozess bietet die Möglichkeit, die Performance Ihres Systems aktiv zu steigern:

Diese dynamische Anpassungsfähigkeit ist die größte Stärke Ihres Systems. LLMs reagieren flexibel auf jede Nutzeranfrage. Die technologische Herausforderung besteht also darin, diese Dynamik so zu orchestrieren, dass sie innerhalb definierter Leitplanken agiert.

Die Beherrschung dieser dynamischen Kette ist der Schlüssel, um das volle Potenzial der Effizienzsteigerung in Unternehmen durch KI freizusetzen. Wenn wir verstehen, wie Datenfluss, Vektorsuche und Sprachmodell interagieren, können wir Qualitätsmaßstäbe definieren, die weit über rein subjektive Bewertungen hinausgehen.

Es geht im ersten Schritt darum, ein Bewusstsein für diese Teilschritte zu entwickeln. Wir platzieren die Messpunkte exakt dort, wo sie Wertschöpfung sichern. Das Resultat ist ein System, das im harten Enterprise-Alltag absolut verlässlich und revisionssicher performt.

Das Verständnis für die dynamischen Herausforderungen moderner KI-Systeme ist für Entscheider weit mehr als eine technische Notwendigkeit, es ist das Fundament für eine nachhaltige Investment-Strategie. Wenn wir die herkömmlichen Pfade der Qualitätssicherung verlassen und die spezifische Logik von LLM-Pipelines adaptieren, transformieren wir KI von einem experimentellen IT-Projekt in ein skalierbares Business-Asset.

Für die Geschäftsführung bedeutet dieses Bewusstsein den entscheidenden Vorsprung: Es geht darum, die Effizienzsteigerung in Unternehmen durch KI nicht dem Zufall zu überlassen, sondern sie durch professionelles Engineering steuerbar zu machen. Wer die Komplexität der Datenkette heute als gestaltbare Variable begreift, sichert sich die Handlungsfähigkeit für die Skalierung von morgen.

Die Identifikation dieser technologischen Hebel zahlt unmittelbar auf die wirtschaftlichen Kernziele Ihres Unternehmens ein:

SMADEV unterstützt Sie dabei, diese technologischen Herausforderungen nicht als Barrieren, sondern als exklusive Chance zur Wertschöpfung zu nutzen. Indem wir die Dynamik von RAG-Systemen als beherrschbare Prozesskette definieren, legen wir den Grundstein für eine KI-Lösung, die nicht nur technisch überzeugt, sondern einen harten und messbaren ROI liefert.

Die dynamische Natur von Sprachmodellen ist der entscheidende Hebel für Ihre KI-Strategie. Nutzen Sie diese Flexibilität, um das Fundament für echte Effizienzsteigerung durch KI zu legen. Der Weg zu einer verlässlichen Enterprise-Lösung führt über die Transformation der „Black Box“ in eine transparente, messbare Wertschöpfungskette. Durch systematisches Eval-Management machen wir aus Ihrem Prototyp ein robustes Business-Asset, das dauerhaft Wert generiert.

Erfahren Sie mehr über unsere Methodik:

Unser AI-Evals-Ansatz übersetzt komplexe Datenarchitekturen systematisch in wertschöpfende, steuerbare KI-Produkte.

Lassen Sie uns den nächsten Schritt gemeinsam gehen.

Steht Ihr KI-System vor dem Go-live oder planen Sie die Skalierung einer bestehenden Lösung? Lassen Sie uns in einem diskreten Strategiegespräch evaluieren, wie wir die Architektur Ihrer KI-Pipeline für Ihre spezifischen Anforderungen validieren und zukunftssicher skalieren können.

Jetzt kostenfreies Strategiegespräch vereinbaren und konkreten Nutzen für Ihr Unternehmen prüfen

Die Qualität eines RAG-Systems (Retrieval-Augmented Generation) entscheidet direkt über den Business-Impact. Da KI-Modelle im Gegensatz zu klassischer Software nicht-deterministisch agieren, können minimale Abweichungen in der Datenverarbeitung zu falschen oder inkonsistenten Antworten führen. Eine hohe RAG Qualität stellt sicher, dass das System verlässlich arbeitet, das Nutzervertrauen erhalten bleibt und die Investition (ROI) durch prozesssichere Antworten geschützt wird.

Klassische Software folgt einer festen Logik: Gleicher Input führt immer zum gleichen Output. KI-Systeme auf Basis von Large Language Models (LLMs) verhalten sich jedoch probabilistisch. Das bedeutet, dass herkömmliche Richtig/Falsch-Tests nicht ausreichen. Um die KI-Verlässlichkeit zu garantieren, sind neue, systematische Messmethoden notwendig – sogenannte AI-Evals. Diese validieren die gesamte Pipeline vom Daten-Chunking über den Retrieval-Prozess bis hin zur finalen Antwortgenerierung.

Die Fehlerquellen in einer „Black-Box RAG“ sind vielfältig und oft unsichtbar (Silent Failures):

LLM-Ebene: Externe Modell-Updates oder Änderungen im System-Prompt beeinflussen Tonalität und Präzision der Antworten.

Systematische Validierung hilft, diese Variablen zu kontrollieren und die KI-Qualität stabil zu halten.

Daten-Ebene: Unsauberes Chunking (Segmentierung) verändert die Gewichtung in der Vektordatenbank.

Retrieval-Ebene: Vektorsuchen können bei identischen Fragen unterschiedliche Informationsfragmente liefern.

Ohne ein dediziertes Framework für AI-Evaluations riskieren Unternehmen schleichende Qualitätsverluste, die erst bemerkt werden, wenn der Schaden (z. B. falsche Auskünfte gegenüber Kunden) bereits entstanden ist. Systematische Evals ermöglichen eine proaktive Steuerung der Kapitalallokation. Sie optimieren die Total Cost of Ownership (TCO), indem sie Ineffizienzen wie unnötig hohen Token-Verbrauch oder redundante Abfragen identifizieren, bevor die Kosten unkontrolliert skalieren.

Eine nachhaltige Effizienzsteigerung durch KI gelingt nur durch den Übergang von experimentellen Pilotprojekten zu validierten Enterprise-Standards. Durch professionelles Engineering und die Transformation der KI-Infrastruktur von einer Black-Box in eine transparente Wertschöpfungskette werden KI-Systeme revisionssicher. Dies verkürzt die Time-to-Market und schafft einen Wettbewerbsvorteil durch nachweisbare Verlässlichkeit im B2B-Sektor.

Eine transparente Architektur ermöglicht die gezielte Optimierung jeder einzelnen Stufe der Datenkette. Während Black-Box-Lösungen schwer steuerbar sind, bietet ein transparentes System volle Kontrolle über IP-Schutz, Datensicherheit und Antwortqualität. SMADEV unterstützt Unternehmen dabei, diese technologischen Hebel zu identifizieren, um KI nicht nur als IT-Projekt, sondern als skalierbares und wertstabiles Business-Asset zu etablieren.

Künstliche Intelligenz ist gekommen, um zu bleiben, doch der Großteil der KI-Projekte leider nicht. Trotz hoher Erwartungen, teurer Tools und motivierten Teams schaffen es viele Vorhaben nie über die Konzeptphase hinaus. Ihnen fehlt das, was jedes erfolgreiche Projekt benötigt: Eine klar definierte strategische Ausrichtung.

In diesem Beitrag erfahren Sie, warum der Use-Case selbst entscheidend für den weiteren Verlauf Ihres geplanten KI-Projektes ist.

Viele Unternehmen starten ihre KI-Initiativen mit hoher Dynamik: Es werden Workshops durchgeführt, Daten analysiert und erste Prototypen entwickelt. Die Whiteboards füllen sich mit Konzepten zu Big Data und KI, die Präsentationen wirken überzeugend und dennoch kommt das Projekt unerwartet zum Erliegen. Es fehlen ein präzise definiertes Ziel, konkrete nächste Schritte und ein klar erkennbarer Mehrwert. Zurück bleibt lediglich ein digitales Artefakt: ein ansprechender Prototyp in der Schublade und der Eindruck, dass das Projekt deutlich mehr Potenzial gehabt hätte.

Was sind typische Gründe, warum KI-Projekte scheitern?

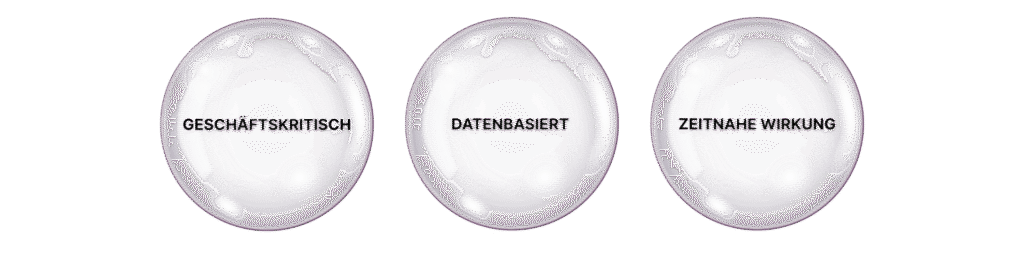

Ein KI-Projekt ohne klaren Use Case ist wie ein Algorithmus ohne Parameter: Er läuft, aber findet keine Lösung. Erfolgreiche KI-Projekte starten nicht mit der Technologie selbst, sondern mit einem konkreten, relevanten Problem.

Sie beginnen im operativen Alltag. Diese realen Herausforderungen sind der Ausgangspunkt, kein abstraktes Zukunftsversprechen oder ein neues gehyptes Tool. Anschließend folgt der nächste Schritt: die Übersetzung des Problems in einen greifbaren Use Case.

Doch ein Use Case allein genügt nicht. Er muss durch einen messbaren Mehrwert ergänzt werden. Erfolgreiche KI-Projekte setzen sich deshalb klare, überprüfbare Ziele, beispielsweise: „Reduktion der Bearbeitungszeit um 40 % innerhalb von sechs Monaten.“ Das ist der Unterschied zwischen einem Experiment und einer echten Initiative.

Praxis-Tipp: Fragen Sie sich zu Beginn:

„Würden wir dieses Projekt auch starten, wenn es keine KI wäre, weil das Problem wichtig ist und gelöst werden sollte?“

Die Suche nach dem passenden KI-Use Case beginnt nicht im Rechenzentrum, sondern mit einem offenen Ohr im eigenen Unternehmen. Die besten Ansätze liegen oft direkt vor der Nase, in Prozessen, die regelmäßig haken, in Aufgaben, die zu viel Zeit kosten, oder in Entscheidungen, die auf Bauchgefühl statt Daten basieren.

Wie findet man sinnvolle KI-Use Cases?

Doch hier wird es spannend: Nicht jedes Problem ist automatisch ein KI-Use Case.

Und nicht jede Idee ist umsetzbar, zumindest nicht sofort.

Die Folge ist der Übergang vom Bauchgefühl zur Struktur: Das Problem wird konkretisiert, der Nutzen geschärft und erste Erfolgsindikatoren werden abgeleitet. Beantwortet wird zudem die Frage, ob sich KI an sich lohnen würde.

Weitere essenzielle Fragen, die wir bei der SMA Development mit unseren Kunden anschließend beantworten sind:

Teil 2 dieser Reihe: „Warum Technologie selten das Problem ist, aber Daten es fast immer sind!„

Jetzt komplettes Whitepaper mit 6-Schritte-Plan kostenlos downloaden!

Alles auf einem Blick. Was erfolgreiche KI-Projekte ausmacht und warum andere scheitern!